EU: AI Act moet gevaarlijke, door AI-gedreven technologie verbieden

De Europese Unie (EU) moet gevaarlijke, door AI (artificiële intelligentie) gedreven technologieën verbieden in de AI Act. Dat zegt Amnesty International vandaag, terwijl de EU de meest uitgebreide wet op het gebied van AI aan het afronden is.

Veel landen wereldwijd gebruiken ongereguleerde AI-systemen om verzoeken voor toeslagen te beoordelen, openbare ruimtes in de gaten te houden, of om vast te stellen wie voorwaardelijk vrijgelaten kan worden. Deze technologieën worden vaak ‘technische oplossingen’ genoemd voor structurele problemen zoals armoede, seksisme en discriminatie. Ze gebruiken enorme hoeveelheden data, die ingevoerd worden in geautomatiseerde systemen om te beslissen of mensen een woning kunnen krijgen, of toeslagen, gezondheidszorg of onderwijs – of zelfs kunnen worden aangeklaagd voor een misdrijf.

Maar in plaats van het oplossen van maatschappelijke problemen, vergroten de AI-systemen racisme en ongelijkheid, en zorgen ze ervoor dat mensenrechtenschendingen en discriminatie in stand worden gehouden.

‘Deze systemen worden niet gebruikt om de toegang van mensen tot bijstand te verbeteren, ze worden gebruikt om kosten te drukken’, zegt Mher Hakobyan van Amnesty International. ‘En wanneer er al institutioneel racisme en discriminatie bestaan, vergroten deze technologiën de schade aan gemarginaliseerde groepen op een veel grotere schaal en met een grotere snelheid.’

‘In plaats van zich onevenredig te focussen op de “existentiële bedreigingen” van AI, moeten de wetgevers van de EU wetten formuleren die bestaande problemen aanpakken, zoals het feit dat deze technologieën ingezet worden om ernstige discriminerende beslissingen te nemen.

Toeslagenschandaal

In 2021 documenteerde Amnesty International hoe een AI-systeem dat werd gebruikt door de Nederlandse Belastingdienst de ontvangers van kinderopvangtoeslag etnisch profileerde. Het systeem zou moeten beoordelen of aanvragen voor kinderopvangtoeslag correct of frauduleus waren, maar het systeem bestrafte onterecht duizenden ouders uit lage inkomensgroepen en met een immigratie-achtergrond, waardoor zij diep in de schulden en armoede terechtkwamen.

Batya Brown werd er onterecht van beschuldigd fraude te hebben gepleegd met de kinderopvangtoeslag. Ze vertelde dat de Belastingdienst eiste dat ze honderdduizenden euro’s terugbetaalde. Ze raakte verstrikt in een web van bureaucratie en financiële angsten. Jaren later is er nog geen zicht op gerechtigheid.

‘Het was zo raar’, vertelt Batya Brown. ‘Ik ontving een brief waarin stond dat ik onterecht kinderopvangtoeslag had ontvangen. En ik dacht, “hoe kan dat?”. Ik was begin 20. Ik wist niet veel over de Belastingdienst. En opeens zat ik in deze wereld vol papierwerk. Ik zag alles uit mijn handen glippen. We zijn erkend als slachtoffers van wat ik noem “het toeslagenmisdrijf” en zelfs 4 jaar later, worden we nog steeds behandeld als een nummer.’ ‘Het Nederlandse toeslagenschandaal moet als waarschuwing dienen voor de wetgevers van de EU’, zegt Mher Hakobyan. ‘Het gebruik van AI-systemen voor toezicht op het verstrekken van essentiële toeslagen kan verwoestende gevolgen hebben voor gemarginaliseerde gemeenschappen. De AI Act moet systemen zoals die bij het toeslagenschandaal zijn ingezet voor sociale scores, profilering en systemen voor het beoordelen van risico’s verbieden.’

Verbied het gebruik en de export van vergaande surveillance-systemen

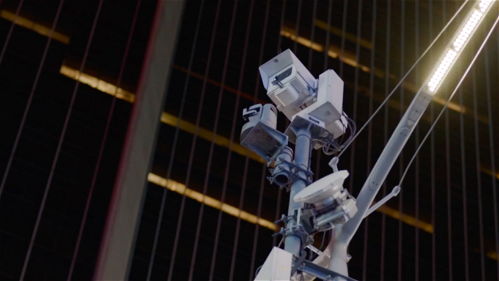

Onder het mom van ‘nationale veiligheid’ zijn gezichtsherkenningssystemen een hulpmiddel geworden voor overheden die mensen buitensporig in de gaten willen houden. Autoriteiten gebruiken deze systemen om mensen te identificeren die mogelijk een misdrijf hebben begaan, ondanks het risico op een onterechte arrestatie.

Amnesty International heeft samen met een coalitie van meer dan 155 organisaties opgeroepen tot een verbod op gezichtsherkenning, zowel real time als achteraf terug te kijken, in openbaar toegankelijke ruimtes, zoals grensgebieden en rondom detentiecentra, door wie dan ook, zonder uitzondering in de EU.

In New York, Hyderabad, en de Bezette Palestijnse Gebieden, heeft Amnesty International gedocumenteerd en aangetoond hoe gezichtsherkenningssystemen bestaande systemen van controle en discriminatie verergeren.

In de Palestijnse Bezette Gebieden gebruiken de Israëlische autoriteiten gezichtsherkenning om Palestijnen te controleren en in de gaten te houden. Hierdoor worden hun bewegingsvrijheid en hun toegang tot basisrechten ingeperkt.

Onderzoek van Amnesty International heeft ook aangetoond hoe camera’s gemaakt door het Nederlandse bedrijf TKH Security voor surveillance worden gebruikt in het bezette Oost-Jeruzalem.

‘Naast dat er een volledig verbod op gezichtsherkenning in de EU moet komen, moeten wetgevers er ook voor zorgen dat deze en andere problematische technologieën verboden worden in de EU. Bovendien moeten deze middelen niet worden geproduceerd in de EU, om vervolgens naar andere landen geëxporteerd te worden waar ze worden ingezet om ernstige mensenrechtenschendingen mee te plegen’, zegt Mher Hakobyan. ‘De EU en de lidstaten zijn onder internationale wetgeving verplicht om ervoor te zorgen dat bedrijven niet profiteren van mensenrechtenschendingen door de export van technologie die wordt gebruikt voor massa-surveillance en racistisch politiewerk.’

AI-technologie maakt misbruik van migranten mogelijk

EU-lidstaten zetten steeds vaker niet-transparante en vijandige technologie in om het misstanden tegen migranten, vluchtelingen en asielzoekers aan hun grenzen te faciliteren.

Wetgevers moeten etnisch profileren en risicoprofielen verbieden. Deze systemen zien migranten en asielzoekers als een ‘bedreiging’. Ook moeten ze voorspellende technologieën verbieden, die worden gebruikt om bewegingen bij grenzen te voorspellen en die mensen het recht ontnemen om asiel aan te vragen.

‘Iedere keer dat je op een vliegveld bent, iedere keer dat je een grens oversteekt, iedere keer dat je solliciteert naar een baan, ben je ondergeschikt aan de beslissingen van deze modellen’, zegt Alex Hanna van Amnesty International. ‘We hoeven echt niet in de Terminator of Matrix te zijn om deze bedreigingen realiteit te maken. Voor mensen is het de realiteit als het hun kansen in het leven en hun levensonderhoud wegneemt.’

AI Act moet Big Tech niet de macht tot zelfregulatie geven

Big Tech-bedrijven hebben ook lobby gevoerd om mazen in het proces van risicobeoordeling van de AI Act te introduceren. Dit zou de tech-bedrijven in staat stellen te bepalen of hun technologie bestempeld moet worden als ‘hoog risico’.

‘Het is van cruciaal belang dat de EU wetgeving aanneemt op het gebied van AI die mensenrechten promoot en beschermd’, zegt Mher Hakobyan. ‘Door tech-bedrijven de macht te geven om zichzelf te reguleren, ondermijnt dit ernstig de belangrijkste doelen van de AI Act, zoals het beschermen van mensen tegen mensenrechtenschendingen. De oplossing hier is simpel – ga terug naar het originele voorstel van de Europese Commissie, waarin een duidelijke lijst staat van scenario’s waarbij het gebruik van AI-middelen van hoog risico is.’

Achtergrond

Amnesty International roept samen met een coalitie van maatschappelijke organisaties geleid door het European Digital Rights Network (EDRi), op tot een door de EU gereguleerde artificiële intelligentie (AI) die mensenrechten beschermt en promoot, waaronder de rechten van vluchtelingen.

In oktober 2023 vinden onderhandelingen plaats, de zogenoemde Trilogues, tussen het Europese Parlement, de Europese Raad (die de 27 lidstaten van de EU vertegenwoordigt), en de Europese Commissie. Het doel van de onderhandelingen is dat de AI Act aan het einde van het lopende EU mandaat in 2024 wordt aangenomen.